1、错误的封禁 在百度的robots.txt的更新上,如果多次点击“检测并更新”就会出现时常可以更新,但是又时常无法更新的问题。如此一来:不应当被收录的东西,在robots.txt上禁止的被收录了,又删除就很正常了。那么它的问题是什么呢?并非服务器负载过度,而是因为防火墙错误的将部分Baiduspider列入了黑名单。

2、服务器异常 常规的服务器就不说了,大家都知道的,北上广的一般都不错。不过有一些特殊服务器,想必绝大多数的站长都不知道吧?例如西部数码的“港台服务器”就很有趣,真的是港台的吗?本身机房在国内,还算什么港台?为了逃避备案而用一个港台的IP,数据全部在国内。

这样有什么不好呢?我们会发现:站点的服务器是经过CDN的,哪怕是你上传的一张图片,都会显示为“302状态码”,访问速度是提升上去了,可是这样利于SEO吗?

3、获取不到真实IP 规模较大的网站,一般都会使用CDN加速,但是有些站点不仅仅对“设备”使用了CDN加速,而且还对Spider使用了加速功能。后的结果是什么呢?如果CDN节点不稳定,那么对网站spider来讲,这个问题将是致命的。

很多大型站点开放CDN的原因就是容易被攻击,这个时候如果不做“蜘蛛回源”就可想而知了。你的站点做了CDN了吗?请登录百度站长平台查看一下spider是否可以抓取真实IP地址吧!

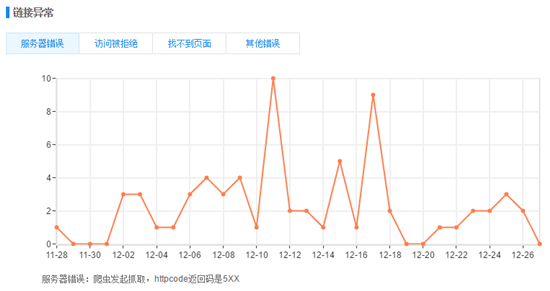

4、频繁的50X类错误

这样的链接其中一个共同的特点是:当打开后,全部都是正常的,那么Spider为什么会报错提醒呢?只是因为在爬虫发起抓取的那一刻,httpcode返回了5XX",你的站点是否频繁有这样的问题呢?有的话需要立即安排技术,或者通报IDC服务商做解决了!

5、错误的抓取比例 任何网站都做不到100%不出问题,但是万事有一个度:我们认为,这个比例不超过5%,对网站基本上是无影响的,且这样的错误不应当每天都出现。常见的抓取错误一般都是连接超时:"抓取请求连接建立后,下载页面速度过慢,导致超时,可能原因服务器过载,带宽不足"这种情况:

A:尽量在不影响图片质量的情况下,对图片进行压缩,上传的时候就进行了压缩。

B:减少如JS脚本文件类型的使用,或者进行合并

C:页面大小进行控制,尤其是一些浏览量、抓取量较高的页面,不建议超过2MB。

D:增加网站的带宽,提升下载速度,或者更换服务器。

今天零度网络关于网站收录服务器端问题就分享到这里,更多网站建设、优化等问题可咨询零度网络技术团队。

网站优化

企业网站建设一条龙

找零度飞易网络公司-fslingdu所做php

网站建设方案、

网站设计、

网站制作由

北京上海深圳龙岗衢州兰州常州东营南通济宁桂林淮安烟台长春无锡天津昆山苏州合肥贵洛阳昆明天津唐山泉州惠州万州新乡商丘台州哈尔滨太原摄影海口随州学校商丘广东湖南广西江西海南广州企业中小企业武汉南山罗湖福田虎门肇庆汕尾汕头广州佛山成都杭州济南重庆福州西安厦门昆山沈阳青岛徐州郑州南京宁南宁长沙大连淄博石家庄南昌温州珠海番禺顺德南三水高明中山东莞合肥江门嘉兴西宁大良容桂伦教勒流陈村均安杏坛龙江乐从北滘祖庙石湾南庄等地区

企业网站建设(广告)公司提供专业做网站价格规划书及

营销型网站制作,

网站建设基础知识

零度飞易是一家专业网站设计,网站制作、seo优化,网站推广,网站建设的佛山网络运营公司。零度飞易在

零度飞易是一家专业网站设计,网站制作、seo优化,网站推广,网站建设的佛山网络运营公司。零度飞易在